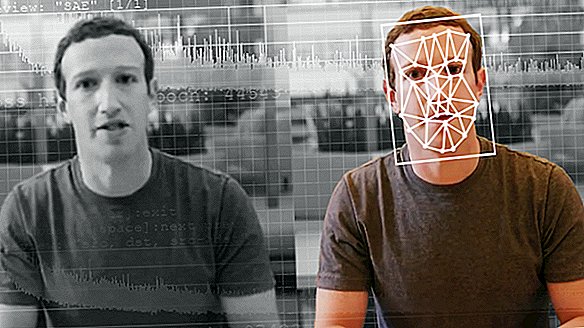

Daripada semua kuasa menakutkan internet, keupayaan untuk mengelabui yang tidak curiga mungkin menjadi yang paling menakutkan. Clickbait, gambar dan berita palsu adalah beberapa pesalah yang paling buruk, tetapi tahun-tahun kebelakangan ini juga telah melihat peningkatan alat yang berpotensi berbahaya yang dikenali sebagai kecerdasan buatan (AI) yang mendalam.

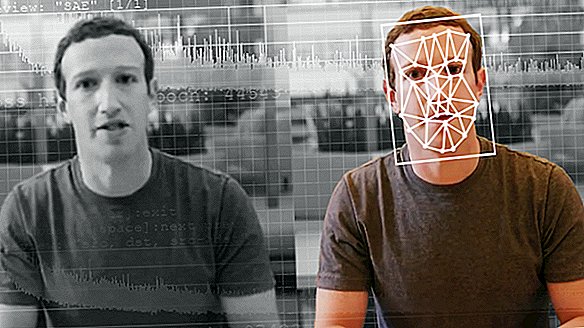

Istilah deepfake merujuk kepada video palsu dan audio yang dijana oleh komputer yang sukar dibezakan daripada kandungan asli yang tidak berubah. Ia adalah untuk filem apa yang Photoshop adalah untuk imej.

Bagaimanakah AI bekerja dengan baik?

Alat ini bergantung kepada apa yang dikenali sebagai rangkaian adversarial generatif (GANs), sebuah teknik yang dicipta pada tahun 2014 oleh Ian Goodfellow, Ph.D. pelajar yang kini bekerja di Apple, Mekanik Popular dilaporkan.

Algoritma GAN melibatkan dua AI yang berasingan, satu yang menghasilkan kandungan - katakanlah, gambar orang - dan musuh yang cuba menebak sama ada imej itu benar atau palsu, menurut Vox. AI yang menjana bermula dengan hampir tidak tahu bagaimana orang melihat, bermakna pasangannya dapat dengan mudah membezakan foto sebenar dari yang salah. Tetapi dari masa ke masa, setiap jenis AI mendapat lebih baik secara progresif, dan akhirnya menghasilkan AI mula menghasilkan kandungan yang kelihatan sempurna seperti kehidupan.

Contoh Deepfake

GAN adalah alat yang mengagumkan dan tidak selalu digunakan untuk tujuan berniat jahat. Pada tahun 2018, lukisan GAN yang dihasilkan meniru gaya artis Belanda "Lama Guru" seperti Rembrandt van Rijn abad ke-17 yang dijual di rumah lelongan Christie untuk $ 432,500 yang luar biasa.

Pada tahun yang sama, deepfakes meningkat menjadi terkenal, terutamanya melalui pengguna Reddit yang pergi dengan nama 'deepfakes', Wakil dilaporkan. Teknik GAN sering digunakan untuk meletakkan wajah-wajah selebriti terkenal - termasuk Gal Gadot, Maisie Williams dan Taylor Swift - ke badan-badan pelakon filem lucah.

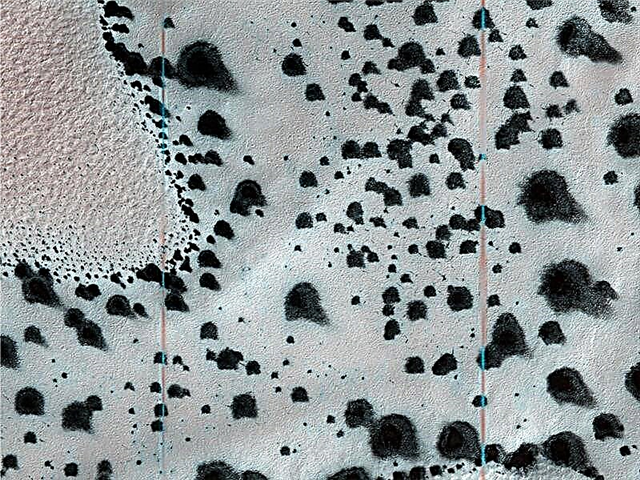

GAN lain telah belajar mengambil gambar tunggal seseorang dan membuat foto atau video alternatif yang agak realistik. Pada tahun 2019, satu kejutan dapat menjana filem menyeramkan tetapi realistik dari Mona Lisa yang bercakap, bergerak dan tersenyum dalam kedudukan yang berbeza.

Deepfakes juga boleh mengubah kandungan audio. Seperti yang dilaporkan oleh The Verge pada awal tahun ini, teknik itu boleh menyebarkan kata-kata baru ke dalam video seseorang yang bercakap, sehingga kelihatan bahawa mereka mengatakan sesuatu yang mereka tidak pernah bermaksud.

Kemudahan yang boleh digunakan oleh alat baru ini mempunyai ramalan yang menakutkan. Jika sesiapa sahaja, di mana sahaja boleh membuat filem realistik yang menunjukkan seorang selebriti atau ahli politik bercakap, bergerak dan mengatakan kata-kata yang tidak pernah mereka katakan, penonton terpaksa menjadi lebih waspada terhadap kandungan di internet. Sebagai contoh, hanya dengarlah amaran Presiden Obama terhadap masa depan dystopian "effed-up" dalam video ini dari Buzzfeed, yang dibuat dengan menggunakan jejak kaki oleh pembuat filem Jordan Peele.