Pernahkah anda membina imej mental seseorang yang tidak pernah anda lihat, berdasarkan semangatnya? Kecerdasan buatan (AI) kini boleh melakukan itu, menghasilkan imej digital muka seseorang dengan hanya menggunakan klip audio ringkas untuk rujukan.

Dinamakan Speech2Face, rangkaian neural - komputer yang "difikirkan" dengan cara yang serupa dengan otak manusia - telah dilatih oleh saintis pada berjuta-juta video pendidikan dari internet yang menunjukkan lebih daripada 100,000 orang yang bercakap.

Dari dataset ini, persatuan belajar Speech2Face yang dipelajari antara isyarat vokal dan ciri-ciri fizikal tertentu dalam wajah manusia, penyelidik menulis dalam satu kajian baru. AI kemudian menggunakan klip audio untuk memodelkan wajah photorealistic yang sepadan dengan suara.

Penemuan telah diterbitkan dalam talian pada 23 Mei dalam aruniv jounral preprint dan belum diteliti rakan sebaya.

Syukurlah, AI tidak (lagi) tahu dengan tepat apa yang dilihat individu tertentu berdasarkan suara mereka sahaja. Rangkaian saraf diiktiraf penanda tertentu dalam ucapan yang menunjuk kepada jantina, umur dan etnik, ciri-ciri yang dikongsi oleh ramai orang, penulis kajian melaporkan.

"Oleh itu, model itu hanya akan menghasilkan muka yang rata-rata," kata saintis. "Ia tidak akan menghasilkan imej individu tertentu."

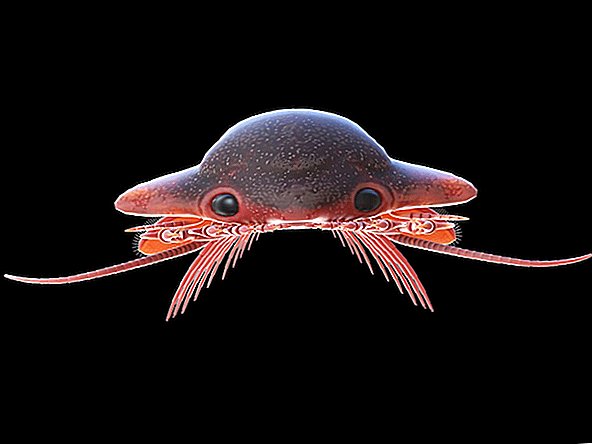

AI telah menunjukkan bahawa ia boleh menghasilkan wajah manusia yang tidak tepat, walaupun interpretasi kucingnya secara terang-terangan sedikit menakutkan.

Wajah yang dihasilkan oleh Speech2Face - semua menghadap depan dan dengan ungkapan neutral - tidak sepadan dengan orang di belakang suara. Tetapi imej biasanya menangkap jajaran umur yang betul, etnik dan jantina individu, menurut kajian itu.

Walau bagaimanapun, tafsiran algoritma jauh dari sempurna. Speech2Face menunjukkan "prestasi bercampur" apabila berhadapan dengan variasi bahasa. Sebagai contoh, apabila AI mendengar klip audio seorang lelaki Asia yang berbahasa Cina, program tersebut menghasilkan imej wajah Asia. Walau bagaimanapun, apabila lelaki yang sama bercakap dalam bahasa Inggeris dalam klip audio yang berbeza, AI menghasilkan wajah seorang lelaki kulit putih, kata para saintis.

Algoritma ini juga menunjukkan kecenderungan gender, mengaitkan suara yang rendah dengan wajah lelaki dan suara tinggi dengan wajah wanita. Dan kerana dataset latihan mewakili hanya video pendidikan dari YouTube, ia "tidak mewakili sama rata seluruh penduduk dunia," tulis para penyelidik.

Kebimbangan lain mengenai dataset video ini muncul apabila seseorang yang telah muncul dalam video YouTube terkejut mengetahui bahawa rupanya telah dimasukkan ke dalam kajian itu, Slate dilaporkan. Nick Sullivan, ketua kriptografi dengan syarikat keselamatan internet Cloudflare di San Francisco, secara tidak diduga melihat wajahnya sebagai salah satu contoh yang digunakan untuk melatih Speech2Face (dan yang algoritma telah direproduksi sebaliknya).

Sullivan tidak bersetuju untuk muncul dalam kajian itu, tetapi video YouTube dalam dataset ini secara meluas dianggap sebagai tersedia untuk penyelidik untuk menggunakan tanpa memperoleh kebenaran tambahan, menurut Slate.